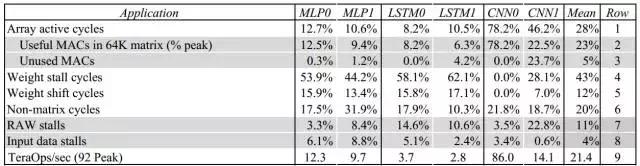

表格3:TPU 在神经网络工作载荷中性能受到限制的因素,根据硬件性能计数器显示的结果。1,4,5,6行,总共100%,以矩阵单元活动的测量结果为基础。2,3行进一步分解为64K权重的部分,我们的计数器无法准确解释矩阵单元何时会停顿在第6行中;7、8行展示了计数器结果,可能有两个原因,包括RAW管道危害,PCIe输入停止。9行(TOPS)是以产品代码的测量结果为基础的,其他列是以性能计数器的测量结果为基础的,因此,他们并不是那么完美保持一致。这里并未包括顶部主服务器。MLP以及LSTM内存带宽有限,但是CNN不是。CNN1的测试结果会在文中加以分析。

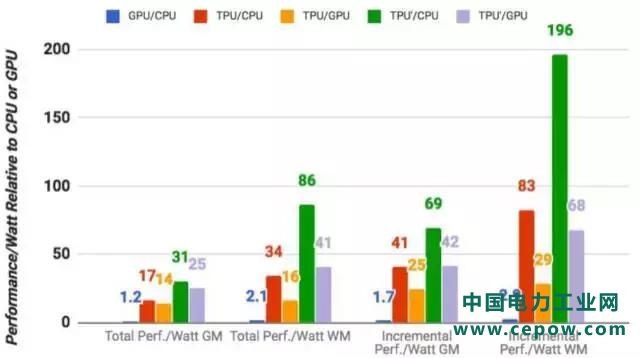

图 9:GPU 服务器(蓝条)对比 CPU、TPU 服务器(红条)对比 CPU、TPU 服务器对比 GPU(橘黄)的相对性能表现/Watt(TDP)。TPU' 是改进版的 TPU(Sec.7)。绿条显示了对比 CPU 服务器的比例,淡紫色显示了与 GPU 服务器的关系。整体包括了主服务器的能耗,但不包括增量(incremental)。GM 和 WM 分别是几何学图形与加权平均值。

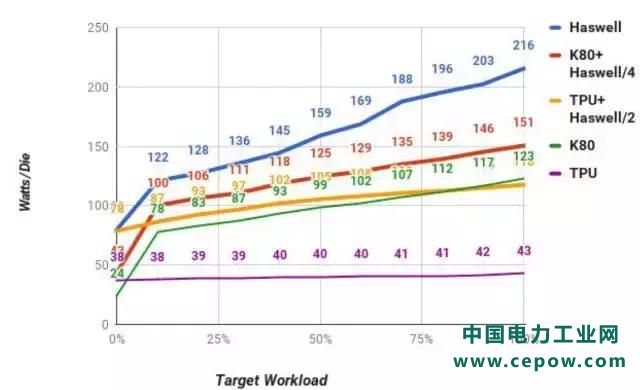

图10:CNN0 平台的单位功耗对比,其中红色和橙色线是 GPU 加 CPU 系统的功率。蓝色是英特尔 E5-2699 v3 Haswell CPU 的功率,绿色是英伟达 Tesla K80 的功率,紫色为谷歌 TPU。每个服务器通常有多个芯片组,以上所有数字都已被整除成单芯片功率。

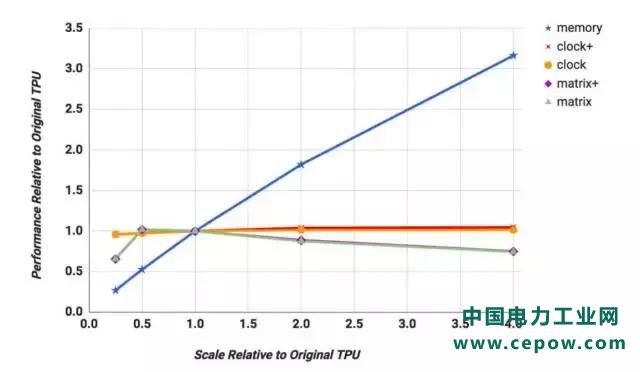

图11:加权平均 TPU 性能作为度量单元,从 0.25 倍扩展到了 4 倍:内存带宽,时钟频率+累加器,时钟频率,矩阵单元维度+累加器,以及矩阵单元维度。加权均值使得我们很难看出单个 DNN 的贡献,但是,MLP 以及 LSTM 提升了 3 倍到 4 倍的内存带宽,但是,更高的时钟频率并没带来任何效果。对于 CNN 来说,结果反之亦然;4 倍的时钟率,2 倍的效果。但是,更快的内存并没带来什么好处。一个更大的矩阵乘法单元并不能对任何 DNN 有帮助。